robots.txtってなに??

Webサイトを担当している人やSEO対策をしている人には、robots.txtという言葉をよく目にしますよね。

私も、つい3か月前まではrobots.txtがどういう効果をもたらすのか一切知りませんでした。

実は、SEO対策をする上で知るべき重要な言葉になります。

なぜなら、Google(検索エンジン)のクローラー(ロボット)を円滑に効率よくWebサイトを回遊してもらえるための手法だからです。

今回は、robots.txtについて小学生でもわかるように解説します。

ぜひ、参考にしてください。

1:robots.txtとは

robots.txtとは、Google(検索エンジン)のクローラー(ロボット)がWebサイトにアクセスしたときに、アクセスを許可するページと許可しないページを指定することができる記述になります。

さらに砕けた言い方をするなら、、、

検索エンジンのロボットに「大事なページだけ見て」と命令することができます。

SEO対策をする上で、なぜ重要になってくるのか?その答えは、クロールが最適化されるからです。

- クローラーはリンクを辿ってWebサイトに訪問する

- ドメインごとにクローラーは回遊する数が決まっている

クローラーの2つの特徴から、robots.txtを効果的に記述することでSEO対策になることがわかりますよね。

1-1:クローラーはリンクを辿ってWebサイトに訪問する

クローラーは、どのようにしてWebサイトにたどり着くのか?

- 内部リンク

- 外部リンク(被リンク)

2つのリンクを辿ってクローラーはWebサイトのページに訪問します。Webサイト内に内部リンクを多く設置しているページには、クローラーも多く訪問してくれるのです。

1-2:ドメインごとにクローラーは回遊する数が決まっている

Webサイト(ドメイン)ごとにクローラーが回遊できるページ数に限りがあることを知っていましたか?

限られたページ数しか回遊できないなら、「大事なページだけ見て」と考えますよね?そんなときにrobots.txtを記述すれば、不必要なページの回遊を避けることができます。

2:robots.txtの書き方と設定

robots.txtを記述して作成するのは、誰でも簡単に書くことができます。

- User-agent

- Disallow

- Allow

- Sitemap

記述する内容は主に4つあり、クロールしてほしいページとクロールしてほしくないページを指定するだけです。

| 指示をする単語 | 必須orどちらでも | 単語の意味 |

| User-agent | 必須 | 指示をするロボットを指定 |

| Disallow | どちらでも | アクセスを拒否するページを指定 |

| Allow | どちらでも | アクセスを許可するページを指定 |

| Sitemap | どちらでも | sitemap.xmlを入力する |

どんなページが不必要なの?と疑問に思っている人は、「ユーザーにとって無価値のコンテンツ」という判断基準で決めましょう。

2-1:User-agent

User-agentとは、指示をするロボットを指定する役割になります。

★User-agentの例

- User-agent: *→すべてのクローラーに指示をするという意味

- User-agent: GoogleBot→Googlebotだけに指示をするという意味

- User-agent: BingBot→BingBotだけに指示をするという意味

クローラーの名前がわからない場合は、「クローラー 名称」と検索すると参考Webサイトがいくつか表示されます。

参考Webサイト:よく見かけるクローラの説明。当サイトによく巡回にくるクローラ Top 11 より。

2-2:Disallow

Disallowとは、アクセスを拒否するページを指定する役割になります。

★Disallowの例

- Disallow: /→すべてのページをアクセス拒否するという意味

- Disallow: a→aのページだけアクセス拒否するという意味

- Disallow:→「アクセス拒否はなし」という意味

ユーザーが見て不必要なコンテンツ(サイトマップや404エラー)には、Disallowを記述しましょう。

2-3:Allow

Allowとは、アクセスを許可するページを指定する役割になります。

★Allowの例

- Allow: /a/b→aのディレクトリにあるbのページだけアクセスを許可するという意味

基本的にDisallowでアクセス拒否してなければ、Allowを記述する必要はありません。

2-4:Sitemap

Sitemapとは、sitemap.xmlを格納するための場所です。記述すると、クローラーがアクセスしやすくなり、Webサイトのクローラビリティを向上することができます。

★Sitemapの例

- Sitemap : https://buzztter.co.jp/sitemap.xml

- Sitemap : https://buzztter.co.jp/index_sitemap1.xml

ファイル名を必ずしも「Sitmap.xml」にする必要はありません。その他の名称でも機能します。

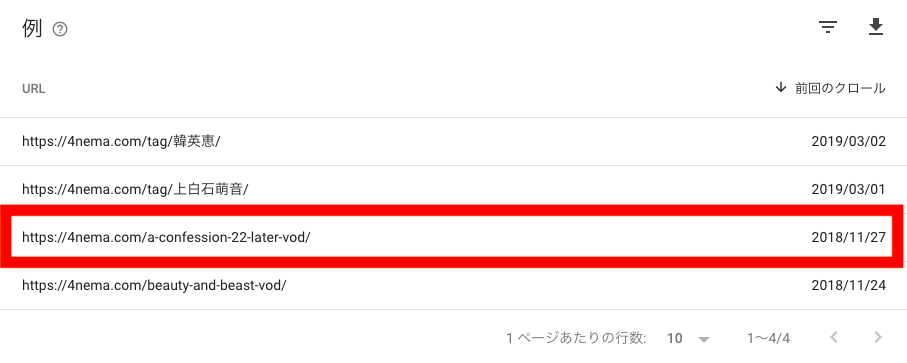

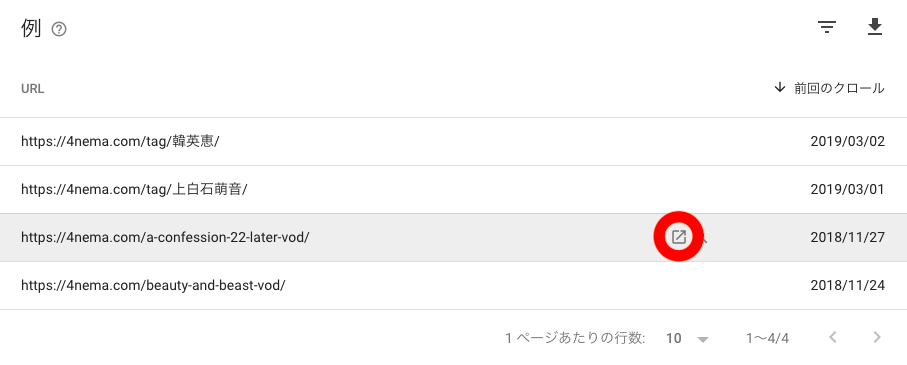

3:robots.txtの動作を確認する方法

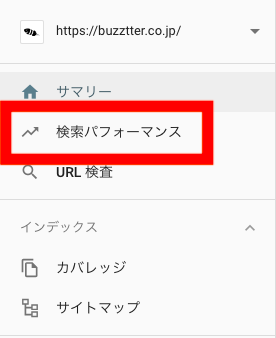

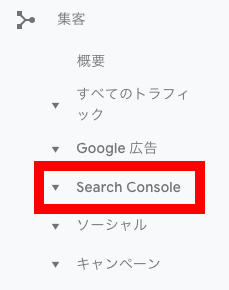

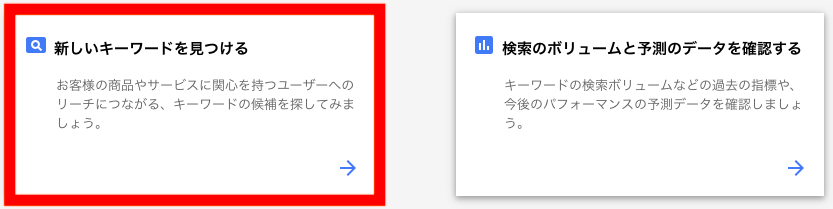

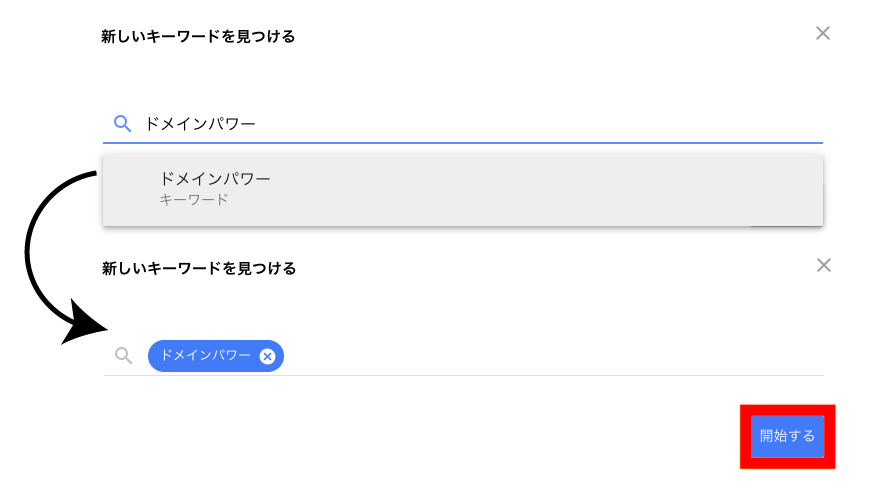

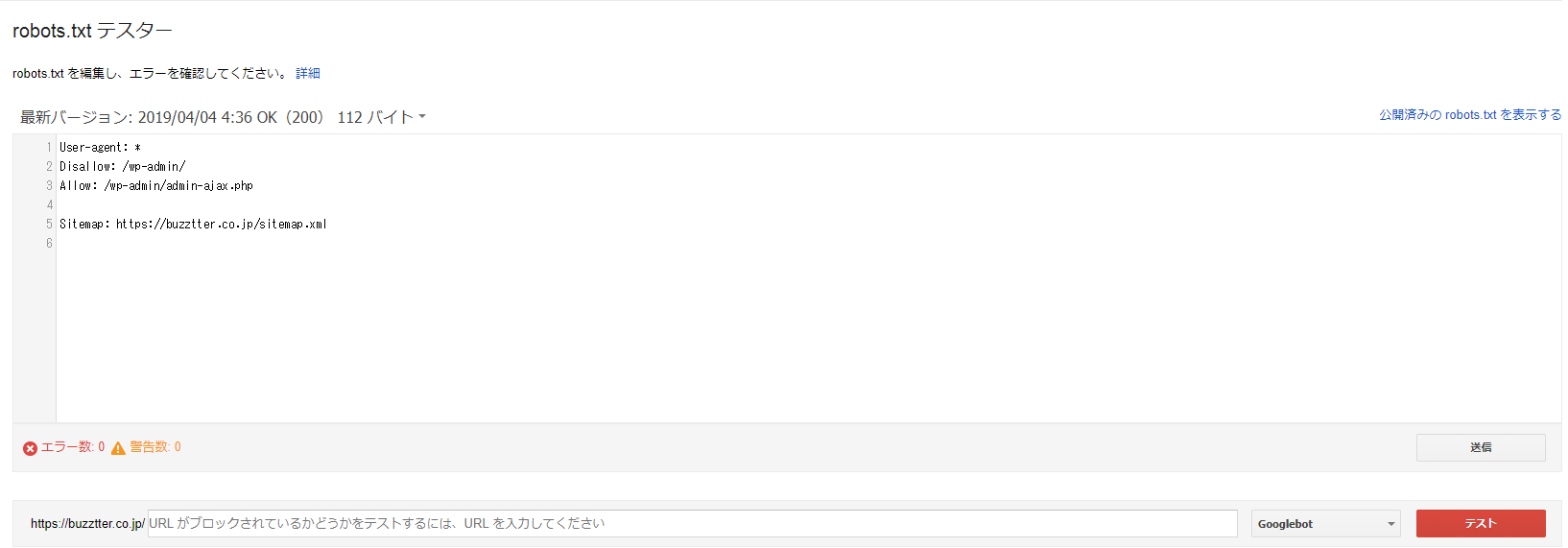

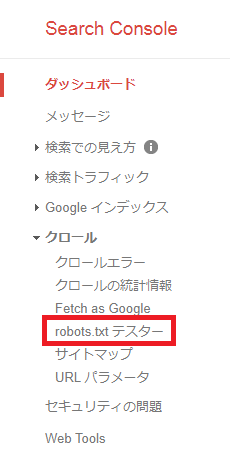

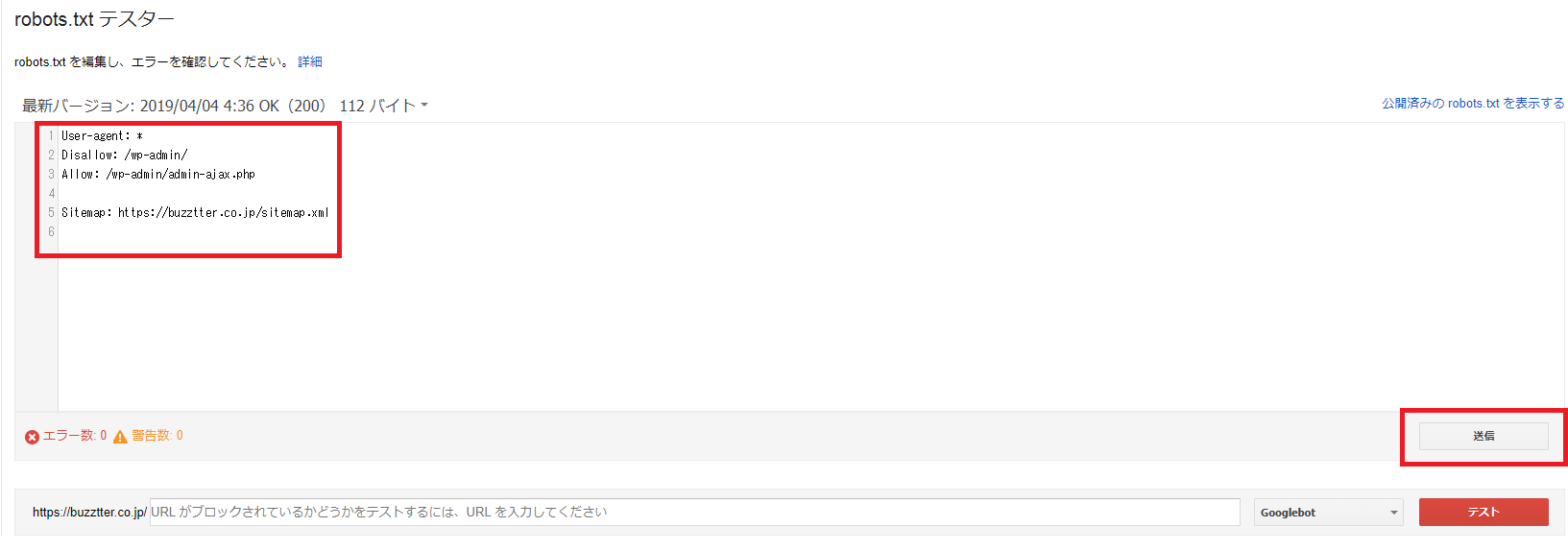

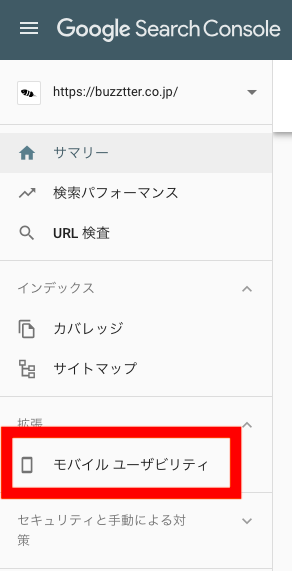

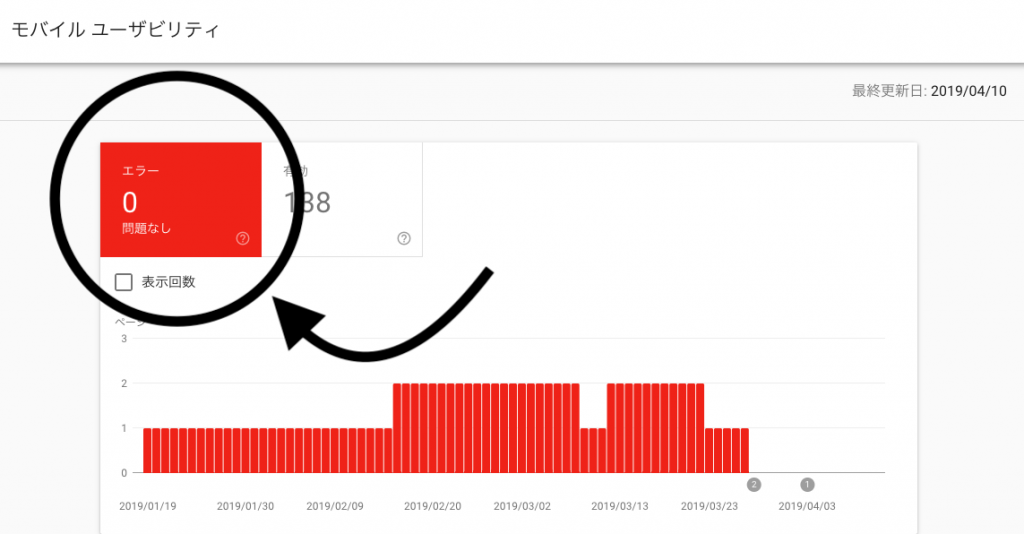

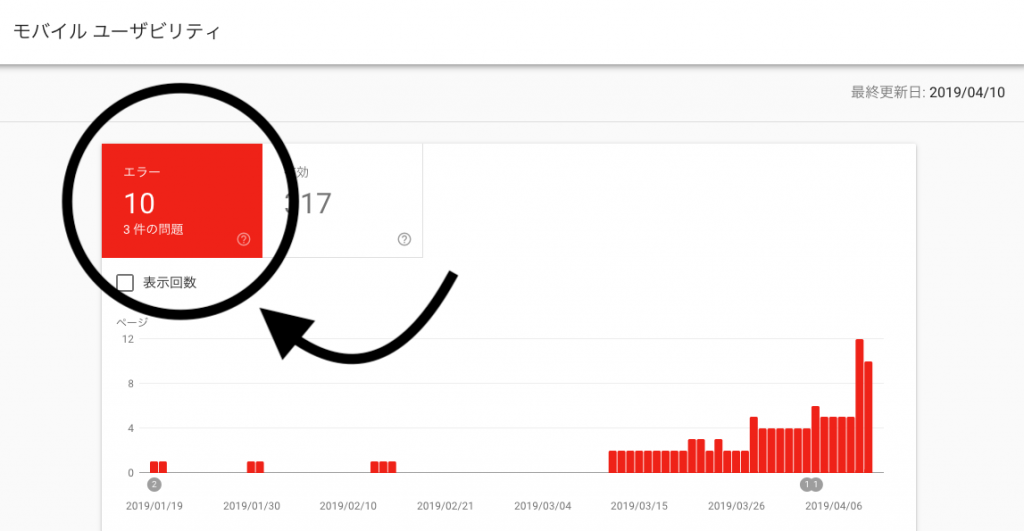

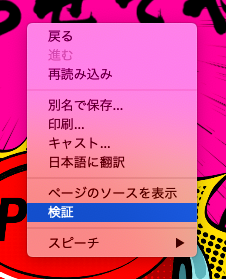

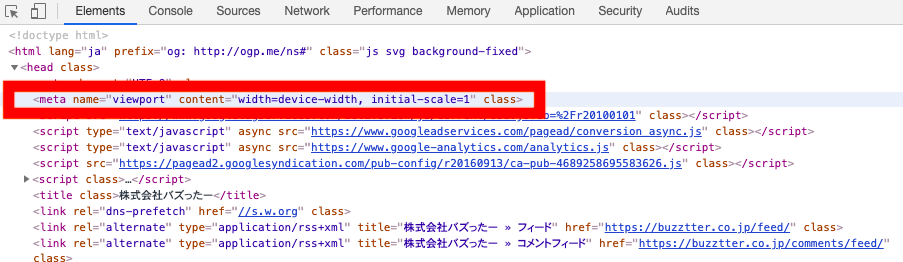

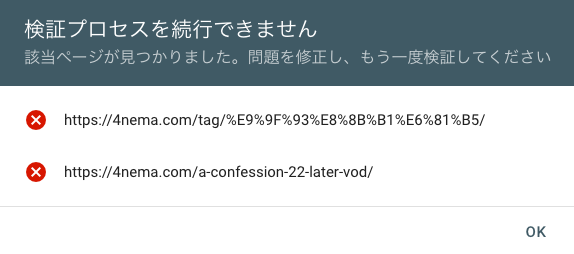

robots.txtの記述が完成したら、GoogleのSearch Consoleで動作を確認することができます。

robots.txtテスターの使い方をわかりやすく手順に沿って解説しましょう。

3-1:robots.txtテスターの使い方

①Search Consoleにログイン

公式サイト:Google Search Console

②ダッシュボードのクロール→robots.txtテスターをクリック

③robots.txtを記述したら「送信」をクリック

あとは、robots.txtの記述が反映されるのを待つだけです。

4:robots.txtについて5つの注意点

robots.txtについて注意しておかなければならない点が5つあります。

- robots.txtは完璧ではない

- 反映されるまでに時間がかかる

- ユーザーはアクセスできる

- ユーザーはrobots.txtを見れる

- 重複コンテンツには使用しない

Webサイトの担当者やSEO対策をしている人は、必ずrobots.txtの注意点を把握しておくべきです。

4-1:robots.txtは完璧ではない

robots.txtを記述して必ずアクセスを拒否できるわけではありません。クローラーの中にはrobots.txtの記述を無視してアクセスを続けることもあります。

4-2:反映されるまでに時間がかかる

robots.txtを記述しても即座に反映されるわけではありません。反映されるまでに数分から数時間かかる場合があります。

4-3:ユーザーはアクセスできる

robots.txtを記述してもユーザーはアクセスすることができます。あくまでもクローラーに命令をしているだけと認識してください。

4-4:ユーザーはrobots.txtを見れる

ユーザーはrobots.txtの記述を見ることができます。見られたくない情報や非公開にしたい場合は、パスワードや認証設定をして対処してください。

4-5:重複コンテンツには使用しない

重複コンテンツにrobots.txtを記述しないでください。重複コンテンツにrobots.txtを記述してしまうと、コンテンツの評価も0になってしまいます。

まとめ

robots.txtはSEO対策をする上で、かかせない内部対策です。

基本的には、アクセスしてほしくないページ(アクセスする必要がないページ)がある場合に使用してください。

効果的にrobots.txtを使用することで、クローラビリティを劇的に向上することができます。

他よりも優れたWebサイトにするためにも絶対に覚えておきましょう。

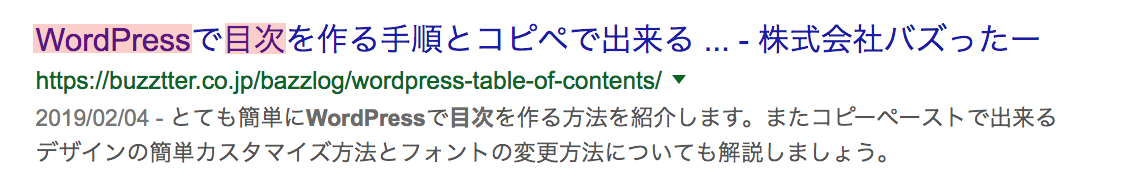

インターネットを利用して何か検索するときに、大体は上の図のような形式で表示されていますよね。

インターネットを利用して何か検索するときに、大体は上の図のような形式で表示されていますよね。